Wilkins & Co. Factory – 1860s – Chase & Bachrach (American, founded about 1865, dissolved 1868)

Ironies of Automation

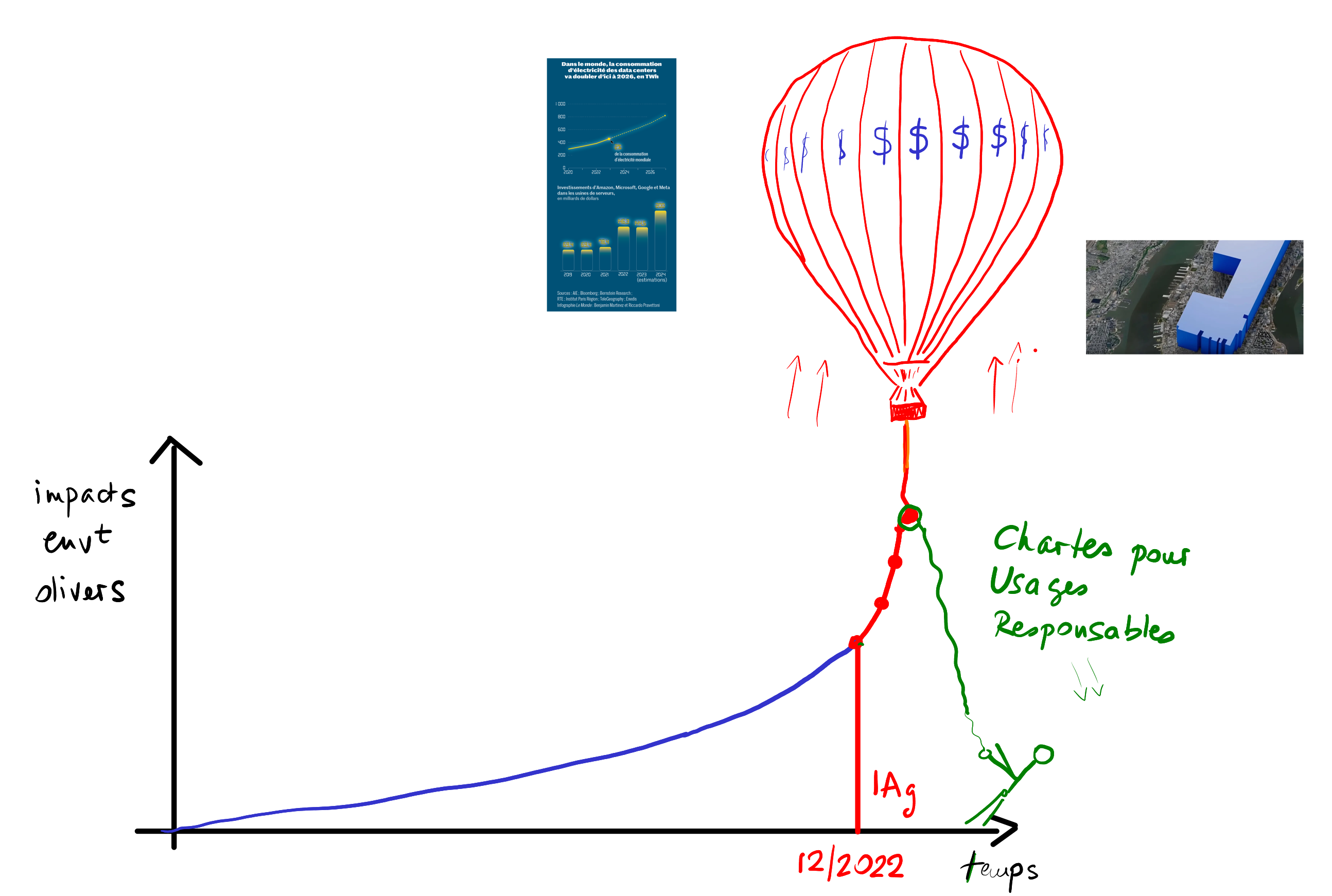

En 1983 Lisanne Bainbridge publia dans une revue d'automatique un article intitulé Ironies of Automation, ce que l'on peut traduire par : les contradictions (ironiques) de l'automatisation. Elle y développe l'idée que, plus un processus est automatisé, plus il doit être surveillé par un être humain compétent, alors même que cet humain perd sa compétence du fait de ne plus exercer le travail que réalise maintenant le système automatique. Toute ressemblance avec les promesses d'une certaine technologie à la mode ces temps-ci serait totalement fortuite.

Dans un article de 2012 intitulé The ironies of automation: still going strong at 30?, les auteurs terminent leur résumé par ce constat tout à fait d'actualité : “The more we depend on technology and push it to its limits, the more we need highly-skilled, well-trained, well-practised people to make systems resilient, acting as the last line of defence against the failures that will inevitably occur.” (Plus nous dépendons de la technologie et approchons de ses limites, plus nous avons besoin de personnes douées, bien formées et expérimentées pour faire en sorte que les systèmes soient résilients, comme dernière ligne de défense contre les pannes qui ne peuvent manquer de se produire – je traduis).

Sûreté des systèmes automatisés

En lisant l'article de L. Bainbridge 43 ans plus tard, on ne peut s'empêcher de penser que, pourtant, des processus industriels ont été automatisés complètement, qui plus est grâce au numérique. C'est le domaine des systèmes embarqués critiques, auxquels on pense relativement peu parce qu'ils fonctionnent vraiment très bien. Par exemple : le freinage automatique dans les métros, même avec conducteur ; la surveillance du cœur des centrales nucléaires qui peut déclencher un arrêt d'urgence ; les commandes de vol d'un avion de ligne ; etc. En revanche certaines promesses qu'on entendait dans les années 2000, comme celle de supprimer la colonne de direction dans les voitures (le drive-by-wire par analogie avec le fly-by-wire), n'ont jamais été réalisées, sans doute car considérées comme trop risquées.

Comment la sûreté de ces systèmes automatisés est-elle assurée ? Une partie de la réponse se trouve dans les principes de conception technique, l'autre dans le cadre de développement de ces systèmes. Côté technique, c'est le règne de la redondance, du déterminisme et de la reproductibilité. Côté cadre, la sûreté des produits repose sur des cycles de développement dédiés, de la traçabilité, des audits indépendants, une attention particulière à la maintenance, une certaine lenteur du processus complet par rapport à d'autres domaines de l'informatique. Dans l'avionique civile la norme DO-178B précise les contraintes de développement des systèmes informatiques selon une classification en cinq niveaux de criticité.

On peut se demander s'il reste un humain “dans la boucle” ? Il est clair que l'humain n'est plus dans les boucles de contrôle qui sont bien trop rapides. Pour certaines boucles le cycle complet (acquisition d'une information sur l'environnement via les capteurs, calculs, production d'une commande vers l'environnement via les actionneurs) peut ne durer que quelques centaines de millisecondes, voire moins. Quand on a décidé d'automatiser les commandes de vol d'un avion de ligne, sachant que le pilote ne pourrait pas se substituer à tous les systèmes automatiques en prenant la place de l'ordinateur “dans la boucle”, la sûreté a été assurée par les choix techniques particuliers et les contraintes qui encadrent le processus de développement. Les pilotes sont formés à la cohabitation avec des systèmes automatisés, pour reprendre la main sur certaines fonctions si le système automatique se désengage, par exemple à la suite de données capteurs non fiables.

Dès qu'on relâche un peu les contraintes sur le cadre de développement, les exigences de certification et la formation des pilotes, cela peut déboucher sur des accidents du type Boeing 737MAX. Et finalement, même si le cadre contraint est respecté, il peut subsister des accidents, malgré tout. Pour certains il semblerait que les contradictions de l'automatisation, comme définies par L. Bainbridge, se soient manifestées. On peut penser au cas du vol Rio-Paris. L'émotion qu'ils suscitent est à la hauteur du degré de confiance qu'on a acquis dans ces systèmes.

Quoi qu'il en soit, personne n'a jamais suggéré d'assurer la sûreté du système automatique de commandes de vol en développant un robot-pilote installé à la place du pilote, lui-même surveillé par un humain. La sûreté du système automatisé est assurée par : des choix techniques, un cadre de développement, la formation des humains amenés à intervenir. C'est en quelque sorte une automatisation de premier ordre. Si les solutions techniques impliquent la redondance entre un système principal et un autre système qui le surveille, c'est d'une certaine manière une surveillance horizontale.

Propositions de l'agentisation : on passe à l'ordre supérieur

Quand on utilise un LLM pour produire du code, il est conseillé de relire et contrôler cette production. C'est un travail pénible, qui demande des compétences que l'être humain va justement perdre en ne pratiquant plus la production de code. Les contradictions (ironiques) de l'automatisation sont de retour. Est-ce que les promoteurs de ces “outils” envisagent d'assurer la qualité du logiciel final grâce à la redondance et à la lenteur, voire la lourdeur, des cadres de développement ?

Force est de constater que les propositions de l'agentisation ressemblent à s'y méprendre à l'idée de développer un robot-pilote installé à la place du pilote, lui-même surveillé par un humain. Quand on signale que surveiller la production de code d'une machine est pénible et risque de ne pas pouvoir assurer la qualité, la réponse est toujours orientée vers plus d'automatisation : des revues de code automatiques, des tests automatiques, un agent IA qui inspecte le travail d'un autre agent IA, etc. Tout cela surveillé par un humain, bien sûr. Lequel est de plus en plus loin de l'activité réelle qu'il pratiquait auparavant et dont il tirait les compétences qui lui sont maintenant d'autant plus indispensables qu'il doit surveiller une armée d'agents infatigables. L'humain “dans la boucle” n'est plus censé surveiller seulement un robot-pilote, mais bientôt les robots-pilotes de toute la flotte d'une compagnie. On passe à une automatisation d'ordre supérieur. Nul doute que les contradictions de l'automatisation passent elles-mêmes au niveau supérieur. Pourtant dès 2020, les auteurices de Closing the AI accountability gap: defining an end-to-end framework for internal algorithmic auditing mentionnaient l'avionique comme source d'inspiration pour une démarche d'audit de bout en bout des systèmes d'IA.

Tout ça ressemble de plus en plus à une autre ironie, celle de cette “information” due à Onion News Network : la sortie d'une nouvelle version du jeu World of Warcraft (WoW), intitulée World of World of Warcraft. Le joueur anime un personnage qui lui-même joue au jeu WoW d'origine. Les personnes interviewées sont unanimes et enthousiastes sur le réalisme du jeu ! On les entend dire :

– Here I'm gonna press Alt-Shift-7 and that's gonna make my character start scrolling through the terms-of-use agreement, and user-licence agreement (ça a l'air vraiment amusant !)

– I'm gonna press my up-arrow key, and that's gonna make him press his up-arrow key, which just gonna make the character on his screen move forward across the screen

– When you're staring at a computer screen, you actually believe you're in a basement staring at a computer screen, with each keystroke you just think “Oh my god! It sounds exactly like keystrokes that I know from my own personal experience of hitting keys”.

Vraiment, redisons-le, toute ressemblance avec les promesses d'une certaine technologie à la mode ces temps-ci serait totalement fortuite.

#resistIAGen

@flomaraninchi@pouet.chapril.org